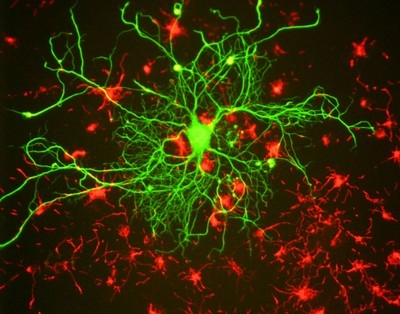

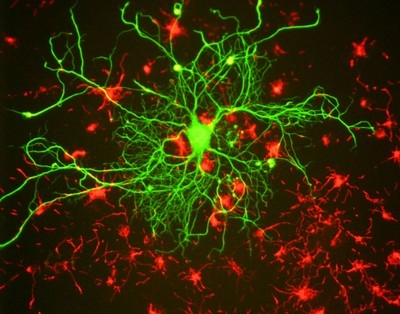

Mimetizar a interconectividade, a densidade de informação e a eficiência energética do cérebro humano é o ideal que norteia as pesquisas mais avançadas e inovadoras no campo da informática. (imagem: Rede de neurônios/GerryShaw/ Wikimedia Commons)

Dispositivo, que pode ser fabricado em substrato flexível, é constituído basicamente por um polímero conjugado, capaz de conduzir não apenas elétrons, mas também íons

Dispositivo, que pode ser fabricado em substrato flexível, é constituído basicamente por um polímero conjugado, capaz de conduzir não apenas elétrons, mas também íons

Mimetizar a interconectividade, a densidade de informação e a eficiência energética do cérebro humano é o ideal que norteia as pesquisas mais avançadas e inovadoras no campo da informática. (imagem: Rede de neurônios/GerryShaw/ Wikimedia Commons)

José Tadeu Arantes | Agência FAPESP – De tudo o que a ciência contemporânea é capaz de observar no Universo, não há nada que supere ou sequer se compare, em funcionalidade, plasticidade e eficiência, ao próprio cérebro humano. O cérebro é capaz de um processamento maciço de informação em paralelo, consumindo, por evento sináptico, uma quantidade de energia da ordem do femtojoule, 10-15 J [para efeito de comparação, uma lâmpada comum de 100 watts consome, a cada segundo, uma quantidade de energia 100 quatrilhões de vezes maior].

Mimetizar, ainda que de forma apenas aproximada, a interconectividade, a densidade de informação e a eficiência energética do cérebro humano é o ideal que norteia as pesquisas mais avançadas e inovadoras no campo da medicina, engenharia e informática.

Um dispositivo eletroquímico orgânico, recém-produzido nos Estados Unidos, constitui contribuição original nesse sentido. Denominado ENODe (do inglês Electrochemical Neuromorphic Organic Device), o artefato, fabricado em substrato flexível, opera em patamares de energia que podem chegar ao picojoule, 10-12 J; exibe mais de 500 estados estáveis de condutância elétrica; e consegue simular com acurácia a função sináptica.

A pesquisa que lhe deu origem foi objeto do artigo “A non-volatile organic electrochemical device as a low-voltage artificial synapse for neuromorphic computing”, publicado em Nature Materiais.

O estudo, conduzido pelo grupo liderado pelo químico italiano Alberto Salleo, no Departamento de Ciência dos Materiais e Engenharia da Stanford University, teve a participação do brasileiro Gregório Couto Faria, do Instituto de Física de São Carlos da Universidade de São Paulo (IFSC-USP). Faria foi apoiado pela FAPESP com Bolsa de Pesquisa no Exterior.

“Apesar de muito simples, o ENODe apresenta uma propriedade típica das estruturas neurais que é a memória multinivelada. Cada unidade do nosso cérebro manifesta cerca de 100 estados de potenciação, que correspondem a diferentes níveis de memória. Em nosso experimento, variando a voltagem, conseguimos mudar a condutividade do material ativo, e, assim, acessar também padrões diferenciados de memória”, disse o pesquisador à Agência FAPESP.

O dispositivo é constituído, essencialmente, por um polímero conjugado, capaz de conduzir não apenas elétrons, mas também íons. Isso lhe possibilita atuar como tradutor – ou, dito de forma mais precisa, como transdutor – de corrente elétrica em corrente iônica. A grande virtude dessa propriedade é que ela permite ao material mimetizar os sistemas biológicos. “Tais sistemas comunicam-se predominantemente por meio de fluxos iônicos. Quando um neurônio interage com outro, o que faz é abrir canais para a passagem de íons e, assim, polarizar o ambiente ao redor. Ao reproduzir essa função, nosso polímero estabelece uma interface entre sistemas artificiais e sistemas vivos”, informou Faria.

Uma aplicação imediata seria utilizar o dispositivo em sensores para detectar a presença de determinadas substâncias ou em próteses para estimular tecidos vivos, como as células cardíacas, por exemplo. Outra aplicação, muito mais ambiciosa, é valer-se da propriedade do material para projetar e produzir dispositivos eletrônicos capazes de imitar estruturas biológicas, como os neurônios.

O desenvolvimento da eletrônica de polímeros conjugados motivou a outorga do Prêmio Nobel de Química de 2000 a Alan Heeger (Estados Unidos), Alan MacDiarmid (Nova Zelândia) e Hideki Shirakawa (Japão). Na família dos polímeros conjugados, há uma classe específica de condutores orgânicos mistos. Uma das vantagens desses materiais em relação aos seus análogos inorgânicos é que têm uma morfologia muito porosa, semelhante à da esponja. Quando imersos em um meio líquido com a presença de íons, absorvem a solução em seus interstícios. E sua rede de canais intersticiais transforma-se no sistema viário pelo qual os íons podem trafegar.

Durante o trânsito iônico, ocorrem reações de oxidação ou redução do polímero pelos íons. Trata-se do fenômeno que, em ciência dos materiais, recebe o nome de “dopagem”. O ganho (na oxidação) ou a perda (na redução) de elétrons afeta a condutividade elétrica do material. E a condutividade pode ser modulada pela variação da tensão aplicada. “É isso que possibilita ao dispositivo apresentar diferentes níveis de memória, configurando assim uma das primeiras condições para a elaboração de uma estrutura neuromórfica”, explicou o pesquisador.

A encruzilhada da computação

Unidades neuromórficas integradas em redes neurais constituem a opção mais ousada para superar o atual impasse da computação.

“De fato, o desenvolvimento da computação está chegando a uma encruzilhada. A chamada Lei de Moore, segundo a qual o número de transístores integrados aos computadores dobra a cada 18 meses, continua valendo. Mas a velocidade de processamento, denominada ‘velocidade de clock’, não está crescendo proporcionalmente, e tende a se estabilizar”, afirmou Faria. Isso se deve a um conjunto de fatores, como, por exemplo, o efeito Joule, isto é, a dissipação de energia na forma de calor, que aumenta com a compactação e miniaturização cada vez maior dos componentes.

“Uma das propostas para superar o impasse é a verticalização das unidades de memória. É o mesmo princípio que se observa na dinâmica urbana. Quando a área para expansão das cidades chega a um limite, elas começam a se verticalizar. O mesmo tenderia a ocorrer nos processadores. Outra saída, mais inovadora, é a substituição da computação de tipo Von Neumann [referência ao matemático húngaro de origem judaica John von Neumann (1903 – 1957)], adotada desde os primórdios da revolução da informática, por uma computação neuromórfica, que busca mimetizar o funcionamento do cérebro”, ponderou o pesquisador.

Na computação tradicional, o bit, a menor unidade de informação que pode ser armazenada ou transmitida, resume-se à alternativa “um ou zero”. E informa se, naquele ponto, o circuito está fechado, possibilitando a passagem de corrente elétrica, ou está aberto, obstruindo o sinal. Em suma, é “sim ou não”, e não há meio-termo. Na computação neuromórfica, cada unidade básica poderia exibir vários estados possíveis: o “sim”, o “não” e diferentes tipos de “talvez”.

Além disso, as redes neurais apresentariam padrões de plasticidade e capacidade de aprendizado cada vez mais semelhantes aos das estruturas biológicas. Isso significa que muitas unidades diferentes poderiam se sincronizar, de modo que o padrão elétrico de uma seria aprendido e assumido por outra.

“Ao lado da memória multinivelada, a capacidade de aprendizado é uma característica muito importante do ENODe”, sublinhou Faria. “Para checar essa capacidade, aplicamos ao dispositivo o teste ‘Cachorro de Pavlov’.”

O teste, baseado nos experimentos realizados pelo fisiologista russo Ivan Petrovich Pavlov (1849 – 1936), associa a oferta de comida ao soar de um sino. Depois de vivenciar tal situação, o cão, que saliva instintivamente ao ver ou cheirar a comida, passa a salivar também cada vez que ouve o sino, mesmo na ausência da comida.

“O que fizemos foi reproduzir esse tipo de condicionamento animal utilizando dois sistemas neuromórficos, um relativo à visão (mimetizando a visão da comida), outro relativo à audição (mimetizando a audição do sino). A variação de condutividade em função do potencial elétrico, que ocorria no sistema de visão, foi ‘aprendida’ pelo sistema de audição, quando os dois sistemas foram integrados”, descreveu o pesquisador.

Parece complicado. Mas, no fundo, tudo se resume à dopagem da estrutura do polímero pelo fluxo iônico.

Os computadores atuais, de tipo Von Neumann, já são capazes de aprender, por tentativa e erro. É o que se chama, em linguagem técnica, de “aprendizado de máquina”, e ocorre até mesmo nos smartphones de última geração. Um marco nessa trajetória evolutiva ocorreu em 1997, quando o campeão mundial de xadrez Garry Kasparov, que muitos consideram o maior enxadrista de todos os tempos, perdeu a partida para o computador Deep Blue, da IBM.

Outro marco aconteceu em 2011, quando uma máquina ainda mais avançada da IBM, o supercomputador Watson, derrotou os dois campeões do programa Jeopardy!, um evento popular de perguntas e respostas da televisão norte-americana (leia em http://agencia.fapesp.br/23290/). Com 15 trilhões de bytes (conjuntos de oito bits) de memória, o equivalente a 5 mil computadores rodando maciçamente em paralelo, o Watson é capaz de ler meio bilhão de páginas em 3 segundos. No torneio, valeu-se do aprendizado de máquina para entender as perguntas capciosas dos apresentadores, encontrar as presumíveis respostas, classificá-las em um ranking estatístico e escolher a alternativa mais provável, em segundos ou frações de segundo.

Porém o que se busca agora é outro tipo de aprendizado, baseado não no acúmulo de bytes em máquinas gigantescas, mas em unidades de processamento multiniveladas, integradas em redes capazes de mimetizar a plasticidade do cérebro humano.

O dispositivo testado no experimento de Stanford possui tamanho macroscópico, da ordem de milímetros. Porém é passível de miniaturização em escala nanométrica por meio de fotolitografia. “Nosso grande objetivo é conectar vários dispositivos neuromórficos e mimetizar redes neurais capazes de executar funções cada vez mais complexas”, resumiu Faria. O horizonte é o computador neuromórfico.

Republicar

A Agência FAPESP licencia notícias via Creative Commons (CC-BY-NC-ND) para que possam ser republicadas gratuitamente e de forma simples por outros veículos digitais ou impressos. A Agência FAPESP deve ser creditada como a fonte do conteúdo que está sendo republicado e o nome do repórter (quando houver) deve ser atribuído. O uso do botão HMTL abaixo permite o atendimento a essas normas, detalhadas na Política de Republicação Digital FAPESP.